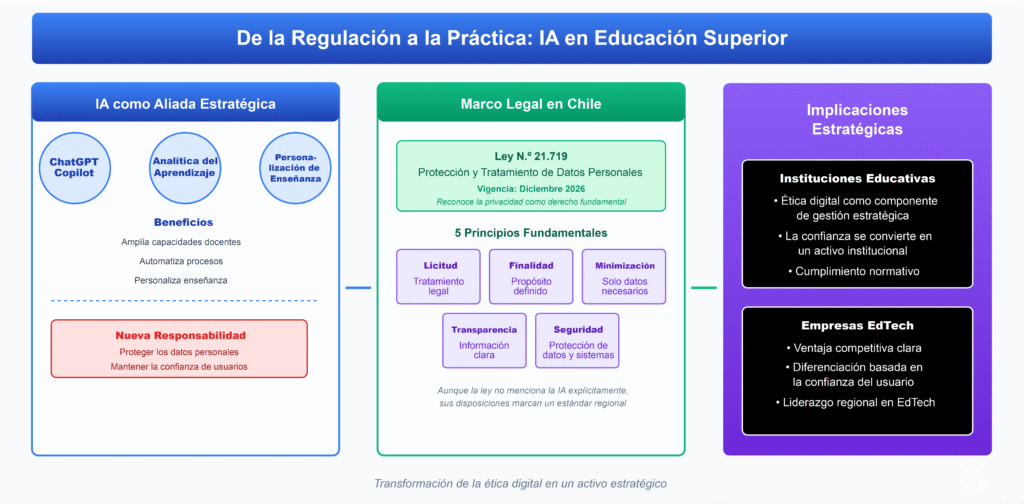

1. De la regulación a la práctica

La inteligencia artificial (IA) se ha convertido en una aliada estratégica de la educación superior y del ecosistema EdTech. Herramientas como ChatGPT, Copilot o sistemas de analítica del aprendizaje amplían las capacidades docentes, automatizan procesos y permiten personalizar la enseñanza. Sin embargo, este avance conlleva una nueva responsabilidad: proteger los datos personales y mantener la confianza de estudiantes, docentes y usuarios.

En Chile, la Ley N.º 21.719 sobre Protección y Tratamiento de Datos Personales —que entrará en vigor en diciembre de 2026— establece un marco moderno que reconoce la privacidad como un derecho fundamental. Sus principios (licitud, finalidad, minimización, transparencia y seguridad) se aplican directamente al uso de IA generativa y sistemas automatizados en educación. Aunque la norma no menciona la IA explícitamente, sus disposiciones marcan un estándar que ya orienta a toda la región (Chile, 2023).

Para las instituciones de educación superior y las empresas EdTech, esto implica transformar la ética digital en un componente de gestión estratégica: la confianza se convierte en un activo, y el cumplimiento normativo en una ventaja competitiva.

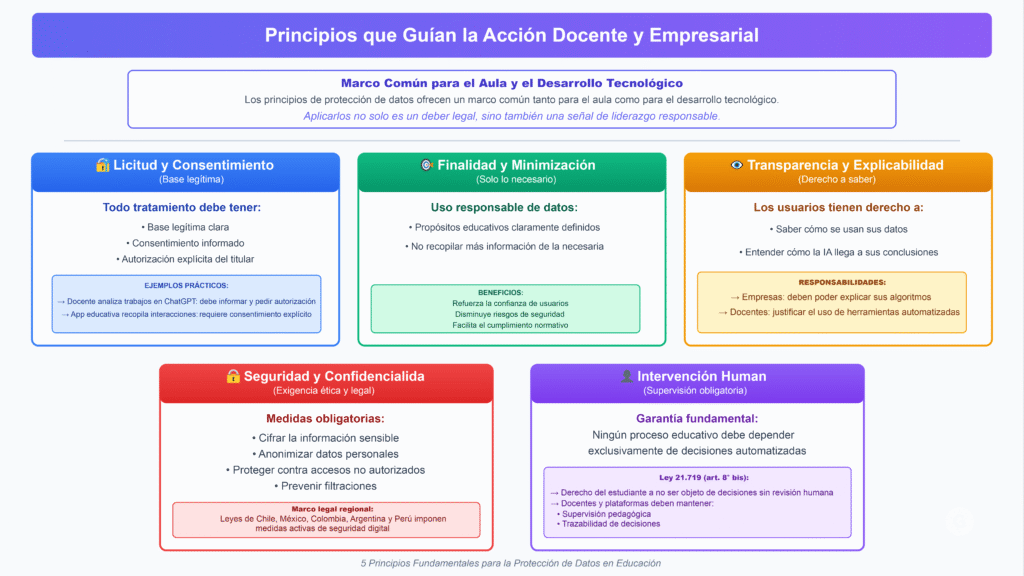

2. Principios que guían la acción docente y empresarial

Los principios de protección de datos ofrecen un marco común tanto para el aula como para el desarrollo tecnológico. Aplicarlos no solo es un deber legal, sino también una señal de liderazgo responsable.

Licitud y consentimiento: Todo tratamiento de datos debe tener una base legítima y un consentimiento informado, especialmente cuando se emplean asistentes de IA generativa (AIG). Un docente que analiza producciones estudiantiles en ChatGPT o una empresa que recopila interacciones en una app educativa deben informar y solicitar autorización explícita del titular de los datos.

Finalidad y minimización: Los datos deben usarse únicamente con propósitos educativos o de mejora de servicio claramente definidos. Evitar recopilar o almacenar más información de la necesaria refuerza la confianza y disminuye riesgos.

Transparencia y explicabilidad: Los usuarios —sean estudiantes o docentes— tienen derecho a saber cómo se usan sus datos y cómo la IA llega a sus conclusiones. Las empresas deben poder explicar sus algoritmos, y los docentes, justificar el uso de herramientas automatizadas en sus evaluaciones.

Seguridad y confidencialidad: Cifrar, anonimizar y proteger la información es una exigencia ética y legal. La ley chilena, al igual que las de México, Colombia, Argentina y Perú, impone medidas activas de seguridad digital para evitar accesos no autorizados o filtraciones.

Intervención humana: Ningún proceso educativo debe depender exclusivamente de decisiones automatizadas. La Ley 21.719 (art. 8° bis) garantiza el derecho del estudiante a no ser objeto de decisiones sin revisión humana. Esto exige que docentes y plataformas mantengan la supervisión pedagógica y la trazabilidad de sus decisiones.

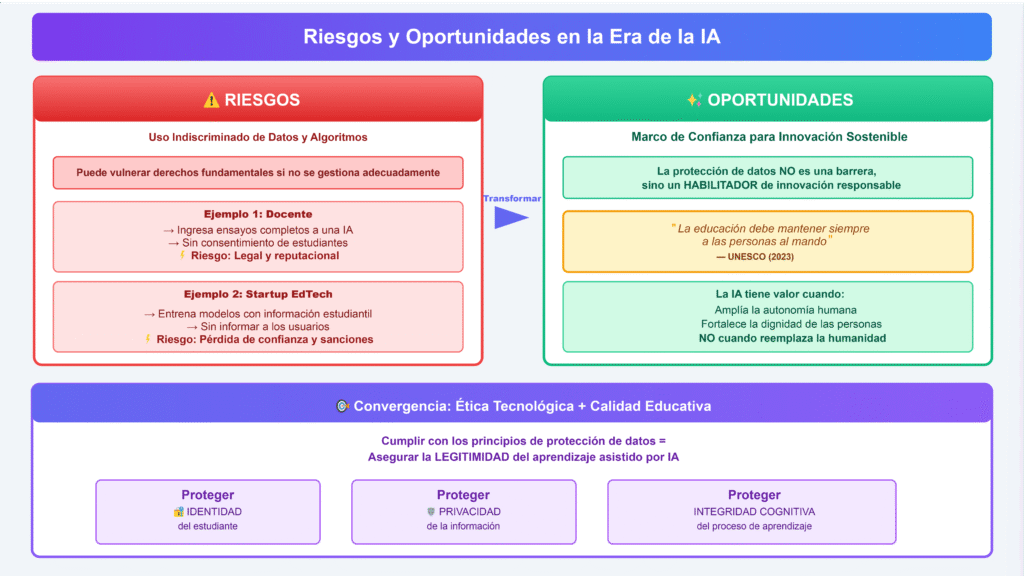

3. Riesgos y oportunidades en la era de la IA

El uso indiscriminado de datos y algoritmos puede vulnerar derechos fundamentales si no se gestiona adecuadamente. Un docente que ingresa ensayos completos a una IA sin consentimiento, o una startup EdTech que entrena modelos con información estudiantil sin informar, enfrentan riesgos legales y reputacionales significativos.

Pero la protección de datos no debe verse como una barrera, sino como un marco de confianza que habilita la innovación sostenible. La UNESCO (2023) subraya que “la educación debe mantener siempre a las personas al mando”, recordando que la IA solo tiene valor cuando amplía la autonomía y la dignidad humana, no cuando la reemplaza.

En este sentido, cumplir con los principios de protección de datos no es solo cumplir la ley, sino asegurar la legitimidad del aprendizaje asistido por IA. La ética tecnológica y la calidad educativa convergen en un mismo punto: proteger la identidad, la privacidad y la integridad cognitiva del estudiante.

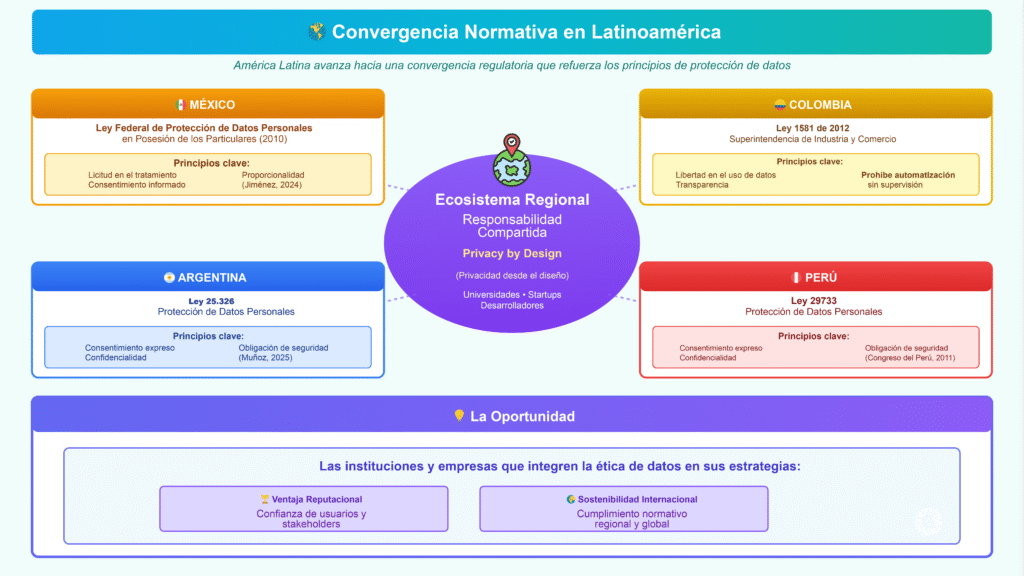

4. Convergencia normativa en Latinoamérica

América Latina avanza hacia una convergencia regulatoria que refuerza estos principios.

México, con la Ley Federal de Protección de Datos Personales en Posesión de los Particulares (2010), exige licitud, consentimiento y proporcionalidad (Jiménez, 2024).

Colombia, mediante la Ley 1581 de 2012, regula la libertad y transparencia en el uso de datos y prohíbe la automatización sin supervisión (Superintendencia de Industria y Comercio, 2012).

Argentina (Ley 25.326) y Perú (Ley 29733) destacan el consentimiento expreso, la confidencialidad y la obligación de seguridad (Muñoz, 2025; Congreso del Perú, 2011).

En conjunto, estas leyes configuran un ecosistema regional de responsabilidad compartida, donde las universidades, startups y desarrolladores deben diseñar experiencias y productos educativos bajo el principio de privacy by design (privacidad desde el diseño).

La oportunidad es clara: las instituciones y empresas que integren la ética de datos en sus estrategias ganarán ventaja reputacional y sostenibilidad internacional.

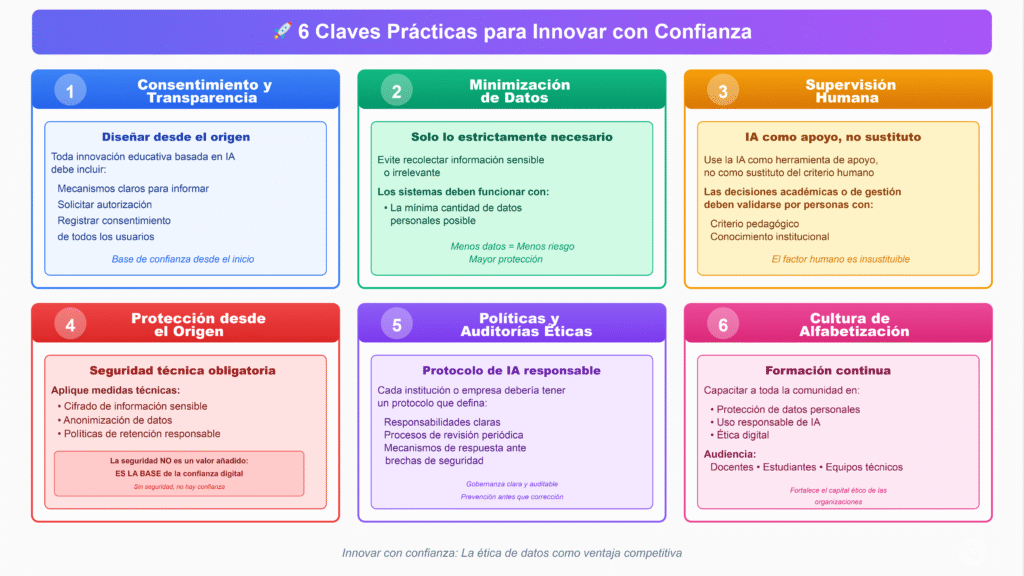

5. Claves prácticas para innovar con confianza

1. Diseñar con consentimiento y transparencia.

Toda innovación educativa basada en IA debe incluir mecanismos claros para informar, solicitar y registrar la autorización de los usuarios.

2. Limitar los datos a lo estrictamente necesario.

Evite recolectar información sensible o irrelevante. Los sistemas deben funcionar con la mínima cantidad de datos personales posible.

3. Mantener la supervisión humana.

Use la IA como apoyo, no como sustituto. Las decisiones académicas o de gestión deben validarse por personas con criterio pedagógico o institucional.

4. Proteger los datos desde el origen.

Aplique cifrado, anonimización y políticas de retención responsable. La seguridad no es un valor añadido: es la base de la confianza digital.

5. Establecer políticas institucionales y auditorías éticas.

Cada institución o empresa debería tener un protocolo de IA responsable que defina responsabilidades, procesos de revisión y mecanismos de respuesta ante brechas de seguridad.

6. Formar una cultura de alfabetización digital y ética.

Capacitar a docentes, estudiantes y equipos técnicos en protección de datos e inteligencia artificial responsable fortalece el capital ético de las organizaciones.

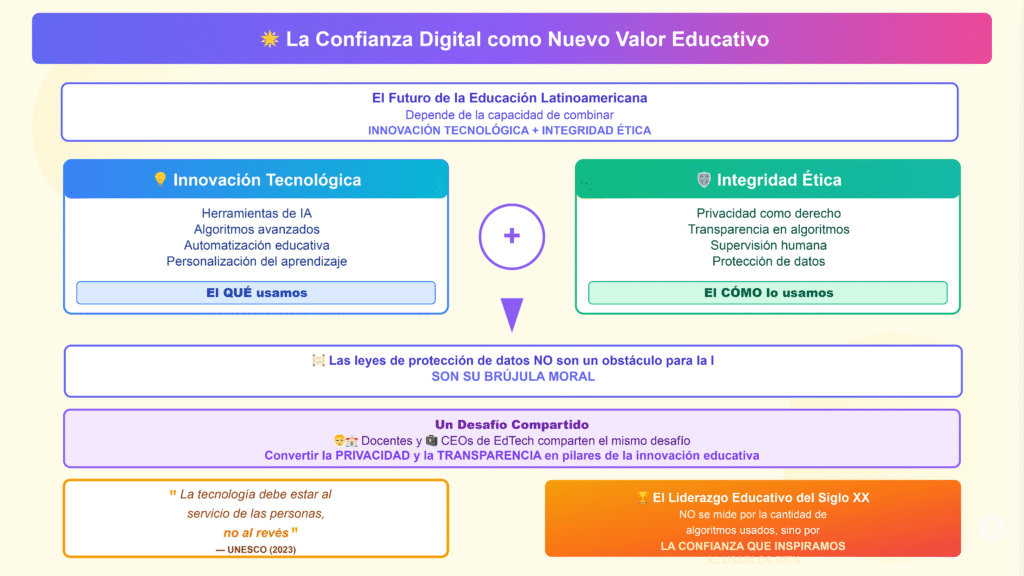

6. Conclusión: la confianza digital como nuevo valor educativo

El futuro de la educación latinoamericana depende de la capacidad de combinar innovación tecnológica con integridad ética. Las leyes de protección de datos no son un obstáculo para la IA, sino su brújula moral.

Docentes y CEOs de EdTech comparten hoy un mismo desafío: convertir la privacidad y la transparencia en pilares de la innovación educativa.

Como señala la UNESCO (2023), “la tecnología debe estar al servicio de las personas, no al revés”.

El liderazgo educativo del siglo XXI no se mide por la cantidad de algoritmos usados, sino por la confianza que inspiramos al usarlos bien.