El Espejismo de la Competencia: Confort Digital, Efecto Dunning-Kruger y la Mediación Estratégica de la Inteligencia Artificial

The Illusion of Competence: Digital Comfort, Dunning-Kruger Effect, and Strategic AI Mediation

Por qué leer este artículo

Tres razones para entender el "espejismo de la competencia" y fortalecer tu prisma antes de que los algoritmos lo hagan por ti.

Resumen

La convergencia entre sesgos metacognitivos, dependencia tecnológica y mediación algorítmica configura un escenario educativo paradójico: las herramientas diseñadas para potenciar el aprendizaje pueden, simultáneamente, erosionar las capacidades cognitivas que pretenden desarrollar. El presente artículo analiza cómo el efecto Dunning-Kruger se transforma —sin desaparecer— en contextos mediados por inteligencia artificial, dando lugar a un estado de confort digital que funciona como analgésico cognitivo. Desde una perspectiva integradora que articula la neurociencia de la atención, la teoría de la mente extendida y los marcos de competencia digital, se argumenta que la amenaza central no reside en la tecnología misma, sino en la opacidad de su mediación sobre el prisma atencional y lingüístico del sujeto. Frente a este diagnóstico, se propone la fricción productiva y la mediación estratégica como ejes para recuperar la autonomía intelectual, y se discuten modelos horizontales de desarrollo de competencias digitales y la noción de descreame profesional como marcos para comprender el impacto diferencial de la IA en los perfiles laborales. El artículo concluye que el fortalecimiento del prisma —la capacidad de percibir, filtrar y articular la experiencia— constituye la competencia fundamental de la era algorítmica.

Palabras clave: efecto Dunning-Kruger, confort digital, descarga cognitiva, inteligencia artificial, mediación estratégica, competencia digital, fricción productiva, descreame profesional

1. Introducción

En la actual era de la información, la arquitectura biológica del ser humano se enfrenta a un entorno tecnológico que parece haber sido diseñado para explotar sus vulnerabilidades evolutivas. La selección natural no optimizó el cerebro humano para la precisión intelectual, sino para la velocidad de decisión y la cohesión social, premiando la certeza sobre la veracidad en entornos de riesgo (Álvarez, 2023). Esta predisposición biológica constituye el terreno fértil sobre el cual operan fenómenos como el efecto Dunning-Kruger (Kruger y Dunning, 1999) y lo que en este artículo denominamos el estado de confort digital: una ilusión de progreso que, paradójicamente, puede inhibir el aprendizaje real.

El panorama se complejiza cuando se incorpora la dimensión algorítmica. Yuval Noah Harari (2018) advirtió que los algoritmos están “observándonos ahora mismo” y que cada vez será más fácil manipular las emociones y deseos más profundos de las personas. Su formulación del “hackeo del ser humano” —la ecuación Conocimiento biológico × Poder computacional × Datos = Capacidad de hackear humanos (Harari, 2020)— adquiere urgencia ante la evidencia empírica reciente que muestra cómo la interacción con inteligencia artificial (IA) no solo amplifica sesgos metacognitivos preexistentes, sino que los transforma cualitativamente (Fernandes et al., 2026; He et al., 2023).

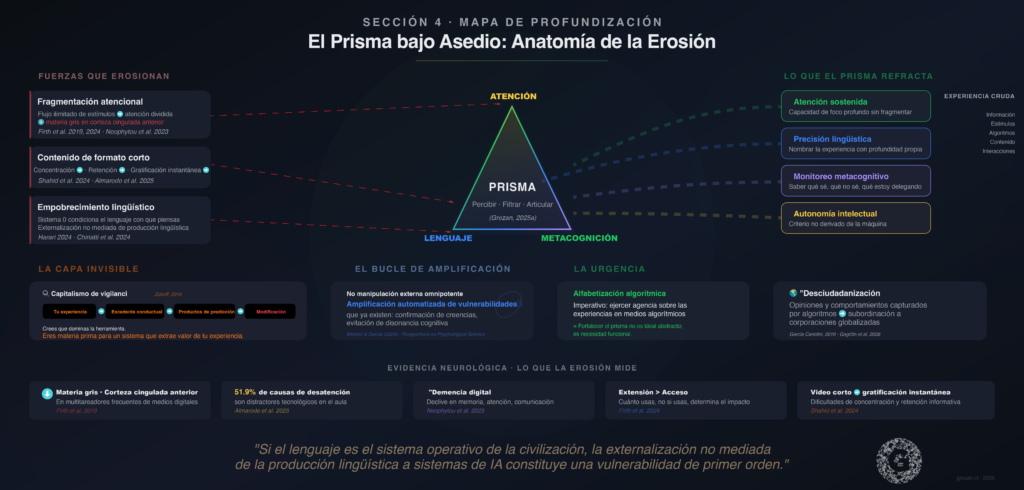

Sin embargo, la respuesta no puede ser el rechazo tecnológico. La verdadera pregunta no es si usar la IA, sino desde qué cuerpo, desde qué prisma atencional y lingüístico interactuamos con ella (Grezan, 2025a). Este artículo propone que la competencia fundamental de la era algorítmica reside en el fortalecimiento de ese prisma: la capacidad de percibir, filtrar y articular críticamente la experiencia antes, durante y después de la mediación tecnológica.

Para desarrollar este argumento, el artículo se estructura en cinco secciones. Primero, se examina la naturaleza del efecto Dunning-Kruger y su transformación en entornos digitales mediados por IA. Segundo, se analiza el fenómeno del confort digital como analgésico cognitivo, articulando la descarga cognitiva con la sociedad paliativa de Han (2021). Tercero, se aborda la mediación algorítmica desde la perspectiva de Harari y su recepción en la literatura académica. Cuarto, se propone la fricción productiva y la mediación estratégica como respuesta, integrando modelos horizontales de competencia digital. Quinto, se discute el concepto de descreame profesional como marco para comprender el impacto diferencial de la IA en los perfiles laborales. El artículo concluye con implicaciones para la investigación y la práctica educativa.

Espejo Metacognitivo

Antes de leer sobre el efecto Dunning-Kruger y el confort digital, te invitamos a un breve ejercicio.

No hay respuestas correctas ni incorrectas. Solo un espejo: lo que crees que sabes vs. lo que la evidencia dice sobre lo que sabemos.

Tu percepción

¿Qué tan capaz te sientes de detectar cuándo una IA te da información incorrecta pero convincente?

Cuando usas IA para trabajar, ¿qué tan seguro/a estás de que el resultado refleja tu criterio y no solo el de la máquina?

¿Qué tan consciente eres de cómo los algoritmos influyen en lo que lees, buscas y decides cada día?

Cuando algo te resulta difícil de entender, ¿con qué frecuencia eliges quedarte con la dificultad en vez de pedir la respuesta a una IA?

Tu promedio: 5.0 / 10

Espejo 1 de 4

Tu espejo metacognitivo

promedio de autoconfianza digital

Este ejercicio no evalúa tu competencia real. Evalúa tu percepción de competencia — que es exactamente donde opera el espejismo.

El artículo que estás por leer explora por qué esa brecha se amplifica con la IA — y qué hacer al respecto.

La competencia fundamental de la era algorítmica:

Fortalecer tu prisma

Percibir · Filtrar · Articular

2. La doble maldición de la incompetencia en la era digital

2.1 Fundamentos del efecto Dunning-Kruger

El efecto Dunning-Kruger (EDK) se fundamenta en un hallazgo empírico consistente: los individuos con menor desempeño en un dominio específico tienden a sobreestimar significativamente su propia competencia, mientras que los de mayor desempeño tienden a subestimarla moderadamente (Kruger y Dunning, 1999). En el estudio original, los participantes ubicados en el cuartil inferior estimaron su rendimiento en el percentil 62 cuando realmente se encontraban en el percentil 12. Dunning (2011) conceptualizó este fenómeno como una “doble maldición”: la misma carencia de habilidad que produce errores es la que impide al sujeto reconocerlos, generando un déficit metacognitivo que se retroalimenta.

Es importante señalar que la interpretación del EDK ha sido objeto de debate metodológico. Gignac y Zajenkowski (2020) demostraron mediante regresión polinomial y LOESS que parte del efecto clásico puede explicarse como un artefacto estadístico derivado de escalas acotadas y regresión a la media. De manera complementaria, Magnus y Peresetsky (2022) confirmaron que la curva en S característica del EDK puede emerger de propiedades estadísticas inherentes a los datos. No obstante, ambos trabajos reconocen que la sobreestimación en los niveles más bajos de habilidad persiste como un fenómeno real, particularmente en dominios donde la retroalimentación es ambigua o demorada —precisamente las condiciones que caracterizan el entorno digital contemporáneo.

2.2 El EDK se transforma en contextos digitales

La evidencia reciente revela que el entorno digital no simplemente amplifica el EDK, sino que lo transforma cualitativamente. Lyons et al. (2021) encontraron que el 75% de los estadounidenses sobreestima su capacidad para distinguir noticias falsas, y que los peores evaluadores eran los más confiados en sus juicios, siendo un 11% más propensos a visitar sitios web no confiables. El dato es particularmente relevante porque vincula el EDK con la susceptibilidad a la desinformación: no se trata de una limitación abstracta, sino de una vulnerabilidad con consecuencias conductuales observables.

En el ámbito de la alfabetización informacional —componente central de la competencia digital—, Mahmood (2016) condujo una revisión sistemática de 53 estudios, encontrando que el 92% no mostraba calibración entre las habilidades percibidas y las reales. Lindell (2023) extendió este hallazgo al dominio político, demostrando que la sobreconfianza en el conocimiento político se asocia significativamente con el uso de internet y redes sociales como fuentes de información, pero no con el consumo de medios tradicionales. El medio digital, por su propia arquitectura, genera una falsa sensación de estar informado sin incrementar el conocimiento real.

2.3 La IA como amplificador metacognitivo

Los estudios más recientes revelan un fenómeno que trasciende el EDK clásico. He et al. (2023) demostraron experimentalmente que la sobreconfianza derivada del EDK causa sub-dependencia de los sistemas de IA: participantes que sobreestimaban su competencia rechazaban recomendaciones algorítmicas correctas, degradando el rendimiento del equipo humano-IA. Significativamente, una intervención tutorial con retroalimentación sobre el desempeño real logró recalibrar eficazmente la autoevaluación.

Sin embargo, el hallazgo más disruptivo proviene de Fernandes et al. (2026), quienes encontraron que cuando las personas utilizan IA generativa (ChatGPT-4o), el patrón clásico del EDK desaparece para dar paso a algo potencialmente peor: una sobreestimación uniforme del rendimiento en todos los niveles de habilidad. En dos estudios (N = 698), todos los participantes sobrevaloraron sus capacidades de manera similar, independientemente de su competencia real. Más aún —y aquí reside la paradoja central—, los participantes con mayor alfabetización en IA fueron menos precisos en sus autoevaluaciones, contradiciendo la suposición de que la familiaridad con la herramienta mejora el monitoreo metacognitivo.

Li et al. (2025) describieron un fenómeno complementario que denominaron “efecto Dunning-Kruger por delegación”: pacientes que consultaban ChatGPT sobre condiciones médicas desarrollaban sobreconfianza no a partir de su propia experiencia, sino de la fluidez lingüística de las respuestas generadas por la IA, incluso cuando estas contenían información imprecisa. Guan et al. (2025) confirmaron que el conocimiento limitado sobre IA genera una relación no lineal con la aceptación tecnológica, mediada por una autoeficacia inflada.

Estos hallazgos configuran un escenario inédito: la IA no solo hereda los sesgos metacognitivos del usuario, sino que los uniformiza y democratiza. Donde antes el EDK diferenciaba entre niveles de competencia, la mediación algorítmica crea un espejismo igualitario de dominio aparente.

🔍 Detector de Espejismos

Acabas de leer sobre la "doble maldición" y cómo la IA transforma el efecto Dunning-Kruger. Ahora viene lo difícil: ¿puedes reconocer el espejismo cuando lo ves en acción?

Verás 6 escenarios reales donde alguien interactúa con tecnología. Tu tarea: identificar qué tipo de espejismo metacognitivo está operando.

⚠️ No todos los escenarios son negativos. Parte de la trampa del EDK es asumir que solo les pasa "a los demás".

Escenario 1 de 6

Aciertos: 0

Tu detección

3. El confort digital como analgésico cognitivo

3.1 De la descarga cognitiva a la dependencia

El concepto de descarga cognitiva (cognitive offloading) designa el uso de acciones físicas o herramientas externas para alterar los requerimientos de procesamiento de información de una tarea (Risko y Gilbert, 2016). Este fenómeno no es intrínsecamente negativo: desde la perspectiva de la mente extendida (Clark y Chalmers, 1998), las herramientas cognitivas forman parte legítima del sistema de pensamiento cuando satisfacen el principio de paridad. Clark (2025), actualizando esta tesis para la era de la IA generativa, reconoce que los humanos somos fundamentalmente “sistemas de pensamiento híbrido” que incorporan recursos no biológicos.

Sin embargo, la evidencia experimental muestra que la descarga cognitiva presenta un costo. Grinschgl et al. (2021) demostraron en tres experimentos preregistrados que, aunque la descarga cognitiva mejora el rendimiento inmediato en la tarea, disminuye significativamente la memoria posterior del contenido descargado. Sachdeva y Gilbert (2020) añadieron que las personas descargan excesivamente —más de lo óptimo para el rendimiento—, impulsadas por la minimización del esfuerzo más que por la maximización de la precisión. Esta tendencia se intensifica en el entorno digital: Gong y Yang (2024), en un metaanálisis del “efecto Google”, confirmaron que la búsqueda intensiva en internet se correlaciona con menor retención informativa, siendo el efecto más pronunciado con el uso del teléfono móvil que con el ordenador.

El paso de la descarga cognitiva a la dependencia de IA constituye un salto cualitativo. Abbas et al. (2024), utilizando el modelo I-PACE, encontraron que la autoeficacia académica y el estrés predicen la dependencia de IA a través de las expectativas de rendimiento, generando un ciclo donde los efectos negativos más reportados incluyen aumento de la pereza, propagación de desinformación, menor creatividad y reducción del pensamiento crítico e independiente. Gerlich (2025) documentó una correlación negativa significativa (r = −0.68) entre el uso frecuente de herramientas de IA y las habilidades de pensamiento crítico, mediada por el incremento de la descarga cognitiva, siendo los participantes más jóvenes quienes exhibieron mayor dependencia y menores puntajes en pensamiento crítico.

3.2 La sociedad paliativa y la evitación de la fricción

El concepto de confort digital puede entenderse como un estado de dependencia tecnológica que simula el crecimiento personal mientras mantiene al individuo en una pasividad cognitiva profunda (Grezan, 2025b). Este estado opera como lo que Byung-Chul Han (2021) denomina un “analgésico” en el marco de la sociedad paliativa: una cultura caracterizada por la algofobia —el miedo al dolor— que evita sistemáticamente toda negatividad. En esta sociedad, las plataformas digitales contribuyen presentando contenido sin fricción, donde los “likes” funcionan como paliativos y el imperativo neoliberal de “ser feliz” impulsa una autoexplotación que enmascara desigualdades estructurales.

La tecnología actual, al eliminar la dificultad inherente a los procesos de búsqueda, reflexión y elaboración, entrena un sistema nervioso orientado hacia la evitación de la complejidad y la automatización de rutas de gratificación inmediata. Jose et al. (2025) conceptualizaron esta dinámica como la “paradoja cognitiva de la IA en educación”: las herramientas que potencian capacidades reducen simultáneamente las oportunidades de recuperación activa y resolución de problemas, procesos esenciales para el desarrollo cognitivo. Hernández-Orallo (2025) complementó esta perspectiva desde la teoría de la mente extendida, advirtiendo sobre los riesgos de atrofia cognitiva, sobredependencia y desafíos para la identidad personal que emergen cuando la IA funciona como “extensora” cognitiva sin mediación crítica.

Chiriatti et al. (2024) propusieron una conceptualización particularmente fértil al introducir el “Sistema 0”: una capa cognitiva tecnológica que precede tanto al pensamiento intuitivo (Sistema 1) como al deliberativo (Sistema 2) de Kahneman. En este modelo, la IA actúa como un preprocesador cognitivo que filtra y orienta la información antes de que el razonamiento humano se active. El confort digital, bajo esta lectura, no es simplemente comodidad; es una alteración de la arquitectura misma del procesamiento cognitivo donde la selección, priorización y enmarcado de la información ocurren en un estrato al que el sujeto no tiene acceso metacognitivo directo.

3.3 El efecto sobre la cognición estudiantil

La evidencia sobre el impacto en contextos educativos es convergente. Jabin (2024), en una revisión sistemática, encontró que la sobredependencia de sistemas de diálogo con IA deteriora potencialmente el pensamiento crítico, la toma de decisiones y el pensamiento analítico, ya que los usuarios aceptan los resultados de la IA —incluidas las alucinaciones— sin validación, impulsados por sesgos cognitivos y atajos mentales. Gonsalves (2024), revisando la taxonomía de Bloom bajo el impacto de la IA generativa, identificó que el uso pasivo de ChatGPT puede suplantar procesos de pensamiento, mientras que el compromiso crítico activo puede potenciar las habilidades de orden superior, abriendo una bifurcación donde el resultado depende enteramente de la intencionalidad del uso.

Essel et al. (2024), en un estudio con diseño pretest-postest (N = 125), hallaron que ChatGPT influye significativamente en el pensamiento crítico, reflexivo y creativo de estudiantes en un aula invertida, pero con el riesgo de descarga cognitiva cuando los estudiantes aceptan pasivamente el contenido generado. Estos resultados subrayan que la herramienta no determina el resultado; lo que determina es la mediación —o su ausencia.

🌡️ Termómetro de Confort Digital

Acabas de leer cómo la descarga cognitiva se transforma en dependencia, cómo la sociedad paliativa evita la fricción y cómo el Sistema 0 filtra tu pensamiento antes de que lo actives.

Ahora la pregunta no es si entendiste el concepto. La pregunta es: ¿dónde opera en tu vida cotidiana?

Tus hábitos digitales

Selecciona los que reconoces como propios. Sé preciso/a: la metacognición empieza por nombrar.

Seleccionados: 0 / 8

Tu mapa de confort digital

Tu reflexión

4. El hackeo atencional y la erosión del prisma

4.1 La mediación algorítmica como captura atencional

Harari (2018) advirtió que la supervivencia intelectual en el siglo XXI exige “correr más rápido que los algoritmos” y conocerse a uno mismo antes de que ellos lo hagan. En Nexus, su obra más reciente, radicaliza esta posición argumentando que la IA ha hackeado el “sistema operativo de la civilización humana” —el lenguaje mismo— y que quienes controlan el lenguaje pueden reescribir las reglas del juego (Harari, 2024). García Canclini (2019) tradujo esta advertencia al contexto latinoamericano: las opiniones y comportamientos de los ciudadanos, capturados por algoritmos, se subordinan a corporaciones globalizadas, produciendo lo que denominó “desciudadanización”.

Sin embargo, la evidencia empírica matiza estas advertencias. Metzler y Garcia (2024), en un artículo publicado en Perspectives on Psychological Science, argumentaron que los mecanismos algorítmicos son “impulsados por motivaciones sociales, creando un bucle de retroalimentación”: los algoritmos refuerzan dinámicas sociales preexistentes más que crear fenómenos enteramente nuevos. Esto no disminuye el riesgo, sino que lo reformula: la amenaza no es una manipulación externa omnipotente, sino la amplificación automatizada de vulnerabilidades cognitivas que ya existen, como la confirmación de creencias previas y la evitación de la disonancia cognitiva.

Lo que Zuboff (2019) conceptualizó como capitalismo de vigilancia —la extracción de excedente conductual para generar productos de predicción— opera precisamente en esta amplificación. El usuario cree dominar la herramienta mientras se convierte en materia prima: datos comportamentales para un sistema que extrae valor de su experiencia privada. En contextos educativos, las plataformas de aprendizaje personalizado pueden funcionar como cadenas de suministro para los flujos de datos del capitalismo de vigilancia, una dimensión que rara vez se discute en la evaluación pedagógica de tecnologías educativas.

4.2 La atrofia del prisma atencional y lingüístico

El concepto de prisma desarrollado por Grezan (2025a) designa la capacidad del sujeto de percibir, filtrar y articular su experiencia del mundo a través de la atención y el lenguaje. Este prisma no es un filtro pasivo, sino una estructura activa que determina la profundidad, amplitud y calidad de la interacción con el entorno —incluido el entorno digital.

La evidencia sobre la degradación atencional asociada a la tecnología digital es consistente y creciente. Firth et al. (2019), en una revisión sistemática publicada en World Psychiatry, documentaron que el flujo ilimitado de estímulos y notificaciones del internet fomenta una atención constantemente dividida, reduciendo la capacidad de concentración sostenida, con cambios neuroestructurales que incluyen menor materia gris en la corteza cingulada anterior entre multitareadores frecuentes. Firth et al. (2024) actualizaron estos hallazgos confirmando que la extensión del uso de internet —no simplemente el acceso— es el factor determinante en la remodelación cognitiva.

Neophytou et al. (2023) describieron el fenómeno de “demencia digital”: un declive en memoria, atención, comunicación y toma de decisiones resultante de cambios estructurales en los centros prefrontales que controlan la atención, la recompensa y el control de impulsos. Shahid et al. (2024) documentaron específicamente que el consumo prolongado de video de formato corto conduce a dificultades de concentración, menor retención informativa y preferencia por la gratificación instantánea. En el ámbito educativo, Almarode et al. (2025) hallaron que los distractores tecnológicos representan el 51.95% de las causas de desatención, generando cambios frecuentes de foco y menor rendimiento académico.

La erosión del prisma no se limita a la atención; compromete también la dimensión lingüística. Cuando el “Sistema 0” (Chiriatti et al., 2024) pre-procesa y enmarca la información antes de que el sujeto la reciba, el lenguaje con el que se piensa la experiencia viene condicionado por la mediación algorítmica. Si el lenguaje es, como sostiene Harari (2024), el sistema operativo de la civilización, la externalización no mediada de la producción lingüística a sistemas de IA constituye una vulnerabilidad de primer orden. El consumo de estímulos de bajo costo cognitivo empobrece el hábito perceptivo, atrofiando no solo la atención sostenida y la memoria de trabajo, sino la capacidad misma de nombrar la experiencia con precisión y profundidad.

4.3 Gagrčin et al. (2026) y la urgencia de la alfabetización algorítmica

Una revisión integradora reciente sobre el uso de medios algorítmicos y la alfabetización algorítmica concluyó que resulta “imperativo que los usuarios puedan ejercer agencia sobre sus experiencias en el uso cotidiano de medios algorítmicos” (Gagrčin et al., 2026). Esta conclusión resuena con la propuesta central de este artículo: el fortalecimiento del prisma no es un ideal abstracto, sino una necesidad funcional ante una arquitectura tecnológica diseñada para capturar la atención y predecir el comportamiento.

5. Posibilidades: fricción productiva y mediación estratégica

5.1 La fricción como condición del aprendizaje genuino

Si el confort digital opera como analgésico cognitivo, la fricción productiva constituye su antídoto. Esta noción tiene raíces profundas en la ciencia del aprendizaje. Bjork y Bjork (2011, 2020) demostraron que las dificultades deseables —condiciones que ralentizan el aprendizaje aparente pero optimizan la retención a largo plazo— incluyen el espaciamiento, la intercalación, la práctica de recuperación, la generación y la variación. El rendimiento actual durante el aprendizaje es un indicador poco fiable del aprendizaje duradero; precisamente las condiciones que parecen producir progreso rápido suelen fracasar en sostener la retención.

De manera convergente, Kapur (2008, 2016) desarrolló el paradigma de fracaso productivo: situaciones de aprendizaje donde los estudiantes generan soluciones antes de recibir instrucción formal, activando conocimiento previo, aumentando la conciencia sobre brechas de conocimiento y enfocando la atención en patrones profundos. Sinha y Kapur (2021), en un metaanálisis de 53 estudios (más de 12,000 participantes), confirmaron que la resolución de problemas seguida de instrucción supera significativamente los enfoques de instrucción primero (g de Hedges = 0.36; ajustado por sesgo de publicación, g = 0.87 —un efecto fuerte).

Más recientemente, el proyecto Friction by Design de WestEd (2025) propuso un marco específico para la era de la IA que distingue entre fricción productiva —esfuerzo, lucha y colaboración que impulsan el crecimiento— y fricción improductiva —barreras que obstaculizan sin beneficio cognitivo—. Sus cinco lentes de diseño (Propiedad Cognitiva, Lucha Productiva, Construcción Social de Sentido, Energía de Activación, Barreras de Acceso) ofrecen un marco operativo: la IA debería reducir la fricción improductiva mientras preserva la fricción productiva esencial para el aprendizaje profundo.

5.2 De la prohibición a la mediación estratégica

La respuesta al confort digital no puede ser la prohibición tecnológica, que reproduce paradójicamente la lógica binaria del propio confort (todo o nada, encender o apagar). La verdadera libertad reside en la conciencia del funcionamiento de la herramienta y en la capacidad de elegir cuándo encenderla y cuándo desenchufarla (Grezan, 2025b).

Chan (2023) propuso un marco integral de políticas de IA para la enseñanza universitaria que equilibra la innovación con las consideraciones éticas, argumentando que las universidades necesitan políticas proactivas que guíen la mediación estratégica de las herramientas de IA, no su prohibición reactiva. Los marcos de competencia de IA de la UNESCO (2024a, 2024b) —tanto para estudiantes como para docentes— posicionan a los profesores como “mediadores clave” en la relación humano-tecnología y a los estudiantes como co-creadores de IA inclusiva, no como meros consumidores.

Romeu Fontanillas et al. (2025) aportaron evidencia empírica para esta perspectiva desde el contexto hispano: en un estudio de métodos mixtos con más de 900 estudiantes, recursos específicos de formación en IA y reflexión ética compartida mejoraron significativamente el conocimiento de los estudiantes sobre IA generativa, ayudándolos a discernir su potencial y sus aspectos críticos. Andión y Cárdenas (2023) reforzaron este argumento desde la educación superior latinoamericana, abogando por la integración y el uso crítico de la IA como alternativa a la prohibición.

Henriksen et al. (2021) mostraron que las tecnologías digitales pueden soportar el fracaso productivo, ofreciendo espacios para la experimentación segura. La fricción productiva a través de la tecnología resulta generativa cuando está respaldada por objetivos claros de aprendizaje y mediada mediante herramientas digitales diseñadas intencionalmente. El diseño pedagógico, no la herramienta, es lo que determina si la IA amplifica o erosiona las capacidades cognitivas.

5.3 Modelos horizontales de competencia digital: la experiencia CD0

Los marcos internacionales de competencia digital —DigCompEdu (Redecker, 2017; Caena y Redecker, 2019), el Marco de Competencias TIC de la UNESCO (2018)— proporcionan estructuras valiosas pero enfrentan desafíos significativos en su implementación en América Latina. Velandia Rodriguez et al. (2022) documentaron la ausencia de consenso o unificación de marcos en Iberoamérica, con la investigación concentrada en España. La OCDE (2020) identificó que aproximadamente el 60% de la población de 16 a 65 años en países como Ecuador y Perú carece de habilidades básicas. Estudios comparativos recientes (Cabero-Almenara et al., 2023; Herrera et al., 2025; IDB/ProFuturo, 2025) confirman que el nivel docente predominante en la región oscila entre básico e intermedio, con brechas pronunciadas en ética digital e integración de IA.

Ante esta realidad, el modelo Competencia Digital Cero (CD0) propone una aproximación radicalmente distinta: un proceso horizontal de aprendizaje entre pares donde “astronautas” (docentes con mayor dominio) acompañan a “cadetes” (docentes en formación) a través de sistemas gamificados de validación (Grezan, 2025b). A diferencia de los modelos descendentes de capacitación que parten de un diagnóstico de déficit, CD0 reconoce que el conocimiento pedagógico es práctico y experiencial, y que los pares constituyen el vehículo más eficaz para su transferencia.

Esta perspectiva se alinea con la evidencia internacional. La OCDE (2023) documentó que casi la mitad de las jurisdicciones apoyan el aprendizaje entre pares docentes sobre recursos digitales, con resultados positivos en el desarrollo de competencias digitales pedagógicas. La OCDE (2025) reconfirmó que el aprendizaje profesional es más efectivo cuando está integrado en la práctica, centrado en contenidos, sostenido en el tiempo y colaborativo. Cebrián Cifuentes et al. (2021), en un estudio cuasiexperimental, encontraron que tras una intervención gamificada las cinco dimensiones de competencia digital aumentaron significativamente. González-Cardona y González-Martínez (2025) y Barroso-Tristán et al. (2025) confirmaron la eficacia de la gamificación en entornos digitales para el desarrollo de la competencia digital docente, aunque esta última revisión PRISMA advirtió que las prácticas tienden a enfocarse en la creación de recursos digitales sin abordar la colaboración ni los recursos educativos abiertos.

La integración del pensamiento complejo —que no se limita a la crítica, sino que articula las dimensiones sistémica, científica e innovadora-creativa (Roa-Castellanos, 2023)— en estos modelos horizontales ofrece una vía para contrarrestar la parálisis del confort digital sin reproducir las jerarquías que alimentan los sesgos metacognitivos.

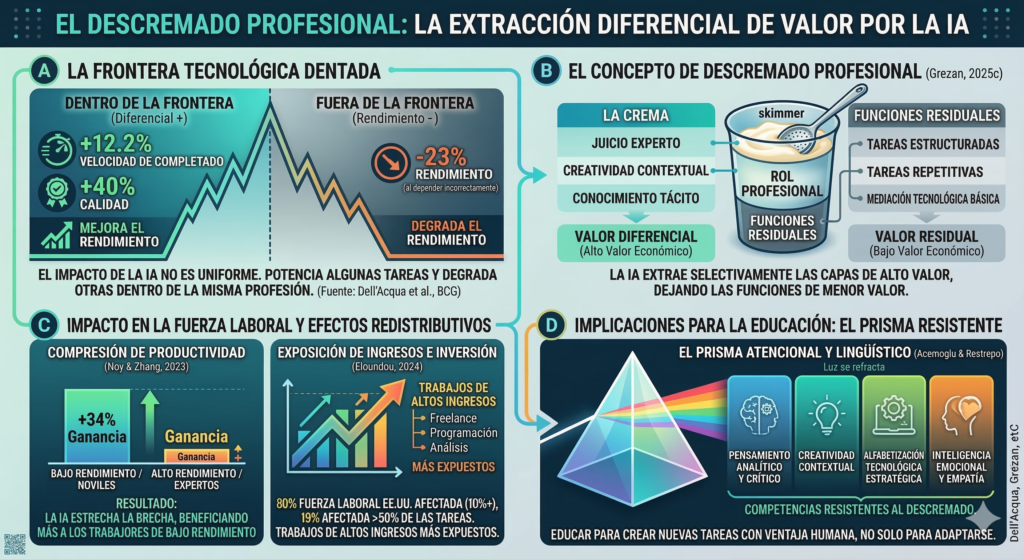

6. El descreame profesional: la extracción diferencial de valor

6.1 La frontera dentada de la automatización

El impacto de la IA sobre los perfiles profesionales no es uniforme ni predecible por la lógica simple de “trabajos manuales vs. intelectuales”. Dell’Acqua et al. (2023), en un experimento de campo preregistrado con 758 consultores de BCG, encontraron que el acceso a IA producía +12.2% más tareas completadas, +25.1% más rápido y +40% mejor calidad —pero solo para tareas dentro de la “frontera” de la IA. Para tareas fuera de dicha frontera, el rendimiento disminuyó aproximadamente un 23%. Este hallazgo es central: dentro de una misma profesión, la IA potencia ciertas tareas mientras degrada el rendimiento en otras, creando lo que los autores denominaron la “frontera tecnológica dentada” (jagged technological frontier).

Eloundou et al. (2024) estimaron que aproximadamente el 80% de la fuerza laboral estadounidense podría ver al menos el 10% de sus tareas afectadas por modelos de lenguaje, y que cerca del 19% podría enfrentar un impacto en más del 50% de sus tareas. Crucialmente, los empleos de mayores ingresos enfrentan mayor exposición —invirtiendo los patrones históricos de automatización. Hui et al. (2024) documentaron evidencia real de desplazamiento en mercados laborales freelance de escritura, programación y análisis de datos tras la introducción de ChatGPT.

6.2 El concepto de descreame profesional

El concepto de descreame profesional (Grezan, 2025c) ofrece un marco para comprender este fenómeno desde la perspectiva educativa. Si la “crema” de una profesión representa el valor diferencial que el profesional aporta —aquel componente de su trabajo que requiere juicio experto, creatividad contextualizada y conocimiento tácito—, la IA opera un “descreame” selectivo: extrae progresivamente las capas de mayor valor económico pero menor resistencia a la automatización, dejando al profesional con las funciones residuales de menor valor.

Este proceso no es simétrico entre profesiones ni dentro de ellas. La tipología del FMI (Cazzaniga et al., 2024) distingue entre alta exposición con baja complementariedad (riesgo de reemplazo) y alta exposición con alta complementariedad (potencial de aumento): aproximadamente el 40% de los empleos globales están expuestos a la IA, cifra que asciende al 60% en economías avanzadas, y la IA puede incrementar la desigualdad salarial si complementa fuertemente a los trabajadores de mayores ingresos.

Sin embargo, la evidencia también muestra potenciales redistributivos. Noy y Zhang (2023), en un ensayo controlado aleatorizado con 453 profesionales, encontraron que ChatGPT redujo el tiempo de tarea un 40% e incrementó la calidad un 18%, y —crucialmente— benefició más a los trabajadores de menor rendimiento, comprimiendo la distribución de productividad. Brynjolfsson et al. (2025), en un estudio de campo con 5,172 agentes de servicio al cliente, confirmaron este patrón: la asistencia de IA incrementó la productividad un 15% en promedio, pero los trabajadores novatos experimentaron una mejora del 34% mientras que los más calificados mostraron ganancias mínimas. La IA diseminó mejores prácticas desde los trabajadores de alto rendimiento hacia los de bajo rendimiento.

6.3 Implicaciones para la educación y la formación

El descreame profesional plantea un desafío fundamental a los sistemas educativos: ¿están formando profesionales cuyo valor diferencial sea resistente a la extracción algorítmica? Los reportes del World Economic Forum (2023), McKinsey Global Institute (2023) y PwC (2025) convergen en señalar que las competencias más demandadas son el pensamiento analítico, el pensamiento creativo, la alfabetización tecnológica y la inteligencia emocional. Morandini et al. (2023) confirmaron que la IA automatiza tareas estructuradas y repetitivas pero permanece limitada en creatividad, empatía y juicio complejo.

La paradoja es que estas competencias “resistentes al descreame” —pensamiento crítico, creatividad, juicio contextual— son precisamente las que el confort digital erosiona cuando la mediación tecnológica no es estratégica. El fortalecimiento del prisma atencional y lingüístico adquiere así una doble relevancia: no solo como competencia educativa general, sino como condición de empleabilidad en un mercado laboral donde la IA redistribuye selectivamente el valor profesional.

Acemoglu y Restrepo (2019) propusieron el marco de desplazamiento-reinstauración: la automatización desplaza trabajadores de tareas existentes pero también crea nuevas tareas donde los humanos mantienen ventaja comparativa. El resultado neto depende de que la “reinstauración” mantenga el ritmo del desplazamiento. La educación, en este marco, tiene la responsabilidad de formar sujetos capaces no solo de adaptarse a tareas nuevas, sino de crear las condiciones cognitivas —el prisma— desde las cuales esas nuevas tareas puedan ser conceptualizadas.

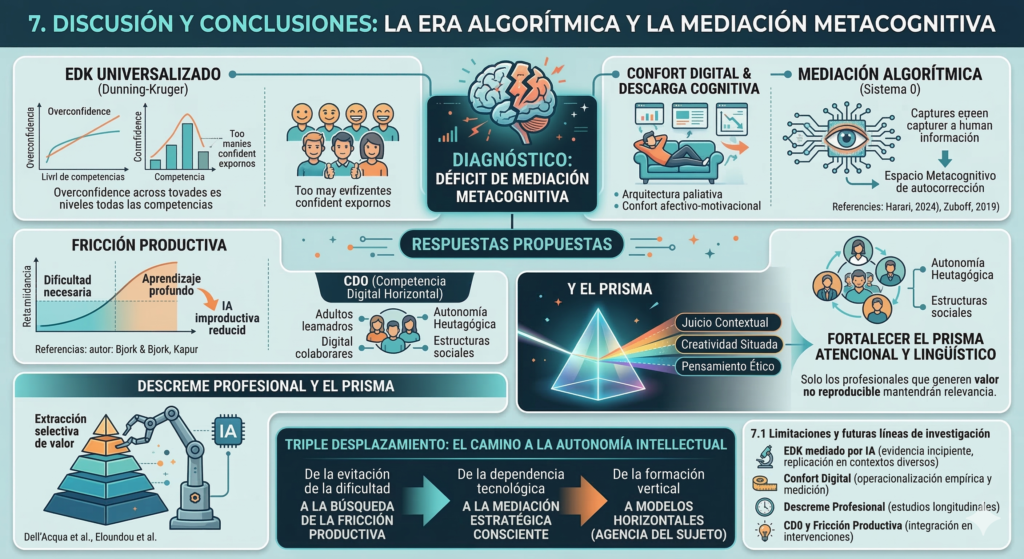

7. Discusión y conclusiones

El análisis presentado revela una convergencia entre tres fenómenos que, considerados aisladamente, parecen de naturaleza distinta pero comparten una raíz común: el déficit de mediación metacognitiva en la interacción con sistemas tecnológicos.

El efecto Dunning-Kruger, al transformarse en contextos mediados por IA (Fernandes et al., 2026), no desaparece sino que se universaliza: la sobreconfianza deja de ser un rasgo de los menos competentes para convertirse en una condición generalizada. El confort digital, nutrido por la descarga cognitiva creciente (Gerlich, 2025; Grinschgl et al., 2021) y la arquitectura paliativa de las plataformas (Han, 2021), proporciona el sustrato afectivo-motivacional para esta universalización: ¿por qué cuestionar la propia competencia si la herramienta produce resultados fluidos, rápidos y aparentemente correctos? La mediación algorítmica, tal como la conceptualizan Harari (2024) y Zuboff (2019), cierra el circuito al capturar la atención y preprocesar la información a través del “Sistema 0” (Chiriatti et al., 2024), reduciendo el espacio metacognitivo disponible para la autocorrección.

Frente a este diagnóstico, la respuesta no puede ser ni el luddismo tecnológico ni la adopción acrítica. La fricción productiva (Bjork y Bjork, 2020; Kapur, 2024; Sinha y Kapur, 2021; WestEd, 2025) ofrece un principio de diseño pedagógico que preserva la dificultad necesaria para el aprendizaje profundo mientras aprovecha las capacidades de la IA para reducir la fricción improductiva. Los modelos horizontales de competencia digital, como CD0, proporcionan estructuras sociales para esta mediación que no dependen de la lógica descendente —y potencialmente infantilizante— de la capacitación tradicional, sino de la autonomía heutagógica del aprendiz adulto.

El concepto de descreame profesional ilumina la urgencia de esta mediación estratégica: si la IA extrae selectivamente valor de los perfiles profesionales (Dell’Acqua et al., 2023; Eloundou et al., 2024), solo los profesionales cuyo prisma atencional y lingüístico les permita generar valor no reproducible por la máquina —juicio contextual, creatividad situada, pensamiento ético— mantendrán relevancia. La educación que no fortalezca este prisma, por más que integre herramientas de IA, estará formando profesionales vulnerables al descreame.

Fortalecer el prisma implica, en términos operativos, tres desplazamientos: de la evitación de la dificultad a la búsqueda de la fricción productiva; de la dependencia tecnológica a la mediación estratégica consciente; y de la formación vertical en competencias digitales a modelos horizontales que reconozcan la agencia del sujeto que aprende. Solo mediante este triple desplazamiento es posible transformar la información en conocimiento real y recuperar la autonomía intelectual en la era algorítmica.

7.1 Limitaciones y futuras líneas de investigación

Este artículo presenta limitaciones inherentes a su naturaleza teórica-integradora. La evidencia sobre el EDK mediado por IA es aún incipiente y requiere replicación en contextos culturales diversos, particularmente latinoamericanos. El concepto de confort digital necesita operacionalización empírica que permita su medición y la evaluación de intervenciones. El descreame profesional, como marco analítico, demanda estudios longitudinales que documenten la evolución del valor diferencial en profesiones específicas tras la adopción masiva de IA generativa. Futuras investigaciones deberían examinar cómo los modelos horizontales como CD0 pueden integrarse con marcos de fricción productiva para diseñar intervenciones que fortalezcan el prisma atencional y lingüístico en contextos educativos formales e informales.